Архитектура высоконагруженных систем: как держать миллион запросов в секунду

Один сервер — один сервер смерти. Если ваш бэкенд живёт на единственной машине, вы не строите продукт — вы строите бомбу замедленного действия. Высоконагруженная система — это не про мощное железо. Это про правильную архитектуру.

Три кита High-Load

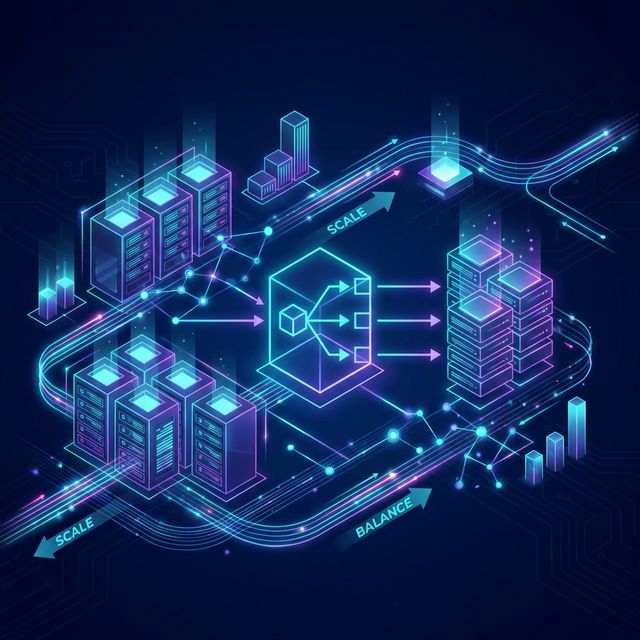

Рис 1. Load Balancer распределяет трафик по пулу серверов

1. Горизонтальное масштабирование (Scale Out)

Правило: Не делайте один сервер мощнее — добавьте больше серверов. Это принципиальная разница между вертикальным (купить машину за $50,000) и горизонтальным (взять 10 машин по $500) масштабированием.

- Плюс: Бесконечный потолок роста. Упал один узел — остальные работают.

- Вызов: Приложение должно быть stateless. Никакого хранения сессий в памяти процесса.

2. Балансировщик нагрузки (Load Balancer)

Балансировщик — это диспетчер. Он принимает все входящие запросы и раздаёт их по живым узлам. Алгоритмы распределения: Round Robin (по очереди), Least Connections (кому меньше всего запросов). Nginx, HAProxy, AWS ALB — выбор на любой бюджет.

3. Кэширование — первая линия обороны

80% запросов в большинстве сервисов — повторяющиеся. Redis или Memcached кэшируют ответы и снимают нагрузку с БД. Правило «cache-aside»: сначала проверяем кэш, при промахе — идём в базу и кладём результат в кэш.

Асинхронность как философия

Не все задачи нужно выполнять синхронно. Отправка email, генерация отчёта, ресайз изображений — всё это кладётся в очередь (Kafka, RabbitMQ, SQS) и обрабатывается воркерами в фоне. Пользователь не ждёт — он получает ответ мгновенно.

Совет NineLab: Начинайте с простого монолита, но проектируйте его так, чтобы было легко вынести сервисы. «Преждевременная микросервисность» убила больше стартапов, чем высокая нагрузка.

Итог: Высоконагруженная система — это не магия. Это балансировщик + stateless-приложение + Redis + очереди + грамотная БД. Каждый слой снимает нагрузку со следующего. Именно так работают Telegram, Авито и Ozon.

Сервисы и материалы по теме

Частые вопросы по теме

Профиль трафика и данные на стенде редко совпадают с боем. Нужны сценарии, те же метрики, что в проде, и поэтапное наращивание с возможностью отката.

Часто первыми «краснеют» база и планы запросов, пулы соединений, синхронные вызовы внешних API и очереди — это даёт быстрый чек-лист проверки.

Не обязательно: инвалидация, холодный старт и неравномерность ключей могут навредить. Кэш проектируют под конкретные read-модели и SLO.

Когда вертикальное масштабирование и оптимизация запросов упёрлись в потолок, а рост данных предсказуем по ключу партиционирования.

Хотите применить это на практике?

Расскажите про вашу систему — предложим план работ и метрики, которые имеет смысл зафиксировать в SLA/SLO.

Статьи по теме

Микросервисы для маркетплейса: когда это необходимость, а когда — лишние миллионы

Рамка решения для CEO и CTO: 5 сигналов, что пора дробить систему, 4 признака преждевременного перехода и честный расчёт — сколько стоит «архитектура как у Ozon» на старте маркетплейса.

Читать статьюRedis, очереди и кэширование: как сделать сайт в 10 раз быстрее без покупки нового железа

Разбираем, почему сайт тормозит при «нормальном» сервере, что кешировать в Redis, какие задачи уводить в очереди, когда подключать CDN — и какие цифры ждать после оптимизации без роста счёта за хостинг.

Читать статьюСколько стоит 1 час простоя вашего сайта: считаем на конкретных примерах

Формула расчёта стоимости простоя для e-commerce, B2B и SaaS: прямые и скрытые потери, коэффициент пика и чеклист подготовки к инцидентам. С привязкой к реальным сбоям инфраструктуры в 2026 году.

Читать статьюРеклама на 10 миллионов и ошибка 503: как техническая неготовность сжигает маркетинговые бюджеты

Разбираем, почему рекламные кампании сгорают из-за упавшего сайта: считаем реальные потери, объясняем три системные причины и даём чеклист подготовки инфраструктуры перед крупным запуском.

Читать статью