Архитектура High-Load: Как строить системы, которые не падают

Ваша система работает отлично для 100 пользователей. Но что случится, если завтра о вас напишет TechCrunch, и придут 100,000? Большинство стартапов умирают не от плохой идеи, а от неспособности масштабироваться. Архитектура High-Load — это искусство строить системы, которые растут вместе с бизнесом.

Вертикальное vs Горизонтальное: Вечная битва

Есть два пути роста. Вы можете купить "сервер побольше" (Scale Up) или купить "много маленьких серверов" (Scale Out).

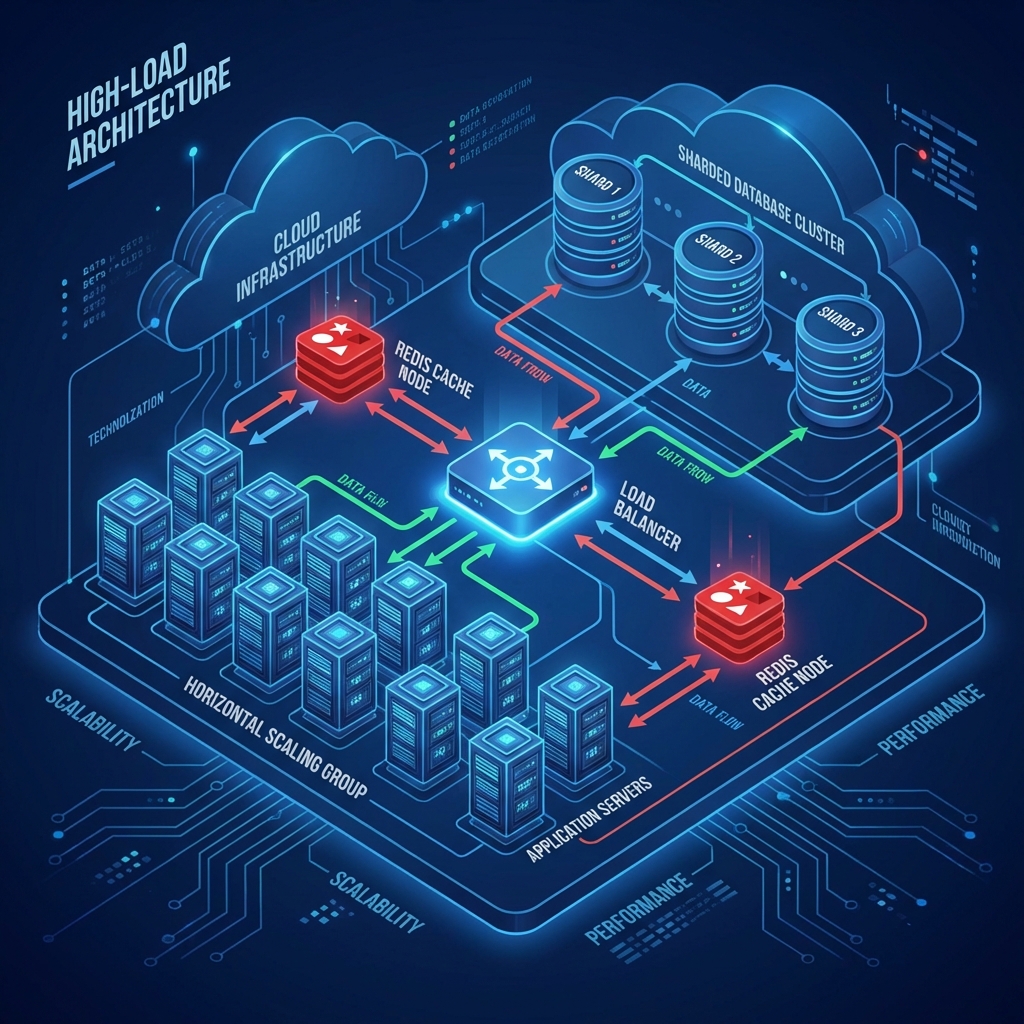

Рис 1. Типовая схема горизонтально масштабируемого веб-сервиса

Ключевые паттерны выживания

- Load Balancing (Балансировка): Nginx или HAProxy на входе распределяет запросы. Если один сервер приложений упал, балансировщик просто перестает слать на него трафик. Пользователь ничего не замечает.

- Database Replication (Репликация): Master-сервер пишет данные, Slave-серверы читают. Это разгружает базу, так как 80% операций в вебе — это чтение.

- Sharding (Шардинг): Когда данных становится петабайты, одна база не справится. Мы "режем" базу на куски (шарды): пользователи A-M на сервере 1, N-Z на сервере 2.

Кэширование: Не грузите базу зря

Самый быстрый запрос — тот, которого не было. Храните горячие данные в оперативной памяти (Redis/Memcached).

Правило: Если данные запрашиваются часто, а меняются редко (профиль пользователя, каталог товаров) — им место в кэше.

Асинхронность и Очереди

Пользователь нажал "Сформировать отчет". Это тяжелая операция. Не заставляйте его ждать с крутящимся спиннером. Отправьте задачу в очередь (RabbitMQ/Kafka), и пусть воркер сделает это в фоне, а пользователю скажите: "Мы пришлем уведомление".

Вывод: High-Load — это не про дорогие сервера. Это про умную архитектуру, где отказ одного компонента не валит всю систему (No Single Point of Failure).

Сервисы и материалы по теме

Частые вопросы по теме

Профиль трафика и данные на стенде редко совпадают с боем. Нужны сценарии, те же метрики, что в проде, и поэтапное наращивание с возможностью отката.

Часто первыми «краснеют» база и планы запросов, пулы соединений, синхронные вызовы внешних API и очереди — это даёт быстрый чек-лист проверки.

Не обязательно: инвалидация, холодный старт и неравномерность ключей могут навредить. Кэш проектируют под конкретные read-модели и SLO.

Когда вертикальное масштабирование и оптимизация запросов упёрлись в потолок, а рост данных предсказуем по ключу партиционирования.

Хотите применить это на практике?

Расскажите про вашу систему — предложим план работ и метрики, которые имеет смысл зафиксировать в SLA/SLO.

Статьи по теме

Микросервисы для маркетплейса: когда это необходимость, а когда — лишние миллионы

Рамка решения для CEO и CTO: 5 сигналов, что пора дробить систему, 4 признака преждевременного перехода и честный расчёт — сколько стоит «архитектура как у Ozon» на старте маркетплейса.

Читать статьюRedis, очереди и кэширование: как сделать сайт в 10 раз быстрее без покупки нового железа

Разбираем, почему сайт тормозит при «нормальном» сервере, что кешировать в Redis, какие задачи уводить в очереди, когда подключать CDN — и какие цифры ждать после оптимизации без роста счёта за хостинг.

Читать статьюСколько стоит 1 час простоя вашего сайта: считаем на конкретных примерах

Формула расчёта стоимости простоя для e-commerce, B2B и SaaS: прямые и скрытые потери, коэффициент пика и чеклист подготовки к инцидентам. С привязкой к реальным сбоям инфраструктуры в 2026 году.

Читать статьюРеклама на 10 миллионов и ошибка 503: как техническая неготовность сжигает маркетинговые бюджеты

Разбираем, почему рекламные кампании сгорают из-за упавшего сайта: считаем реальные потери, объясняем три системные причины и даём чеклист подготовки инфраструктуры перед крупным запуском.

Читать статью